如何使用Adobe软件将2D图片秒变成3D

如何使用Adobe软件将2D图片秒变成3D?Adobe软件是很多人必备的办公软件,很多情况下都可以用到,而且有一系列的软件可以选择,据悉Adobe又出新功能了,在了解这个功能之前,我们先看看下面这张图,你一定会以为这是从视频截图出来的,然而并不是,想要了解就 可以跟小编一起看看Adobe软件将2D图片秒变成3D的教程。

这是 Adobe 放出的新技能,只需要几秒秒,就能让这张静态照片 get 立体感!

这种常用于纪录片等视频的后期制作的特效,名为 Ken Burns Effect。

它可绝对不是简单的缩放哦~我们一起来对比下看看:

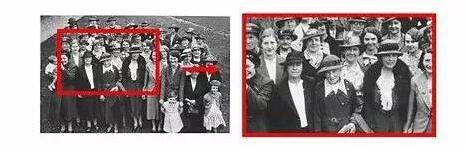

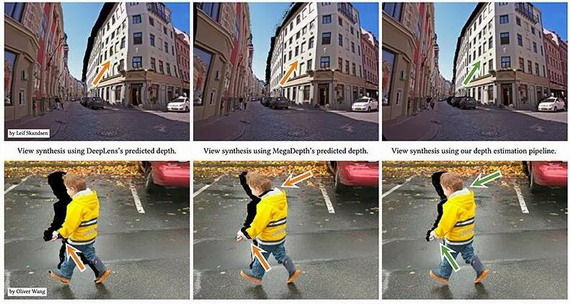

左侧是常用的2D缩放,它通过对静止图像的平移和缩放来产生视差,实现了动画效果。而右边 Adobe 这种 3D 效果不仅有平移和缩放,还有视角转换,给人更真实和更沉浸的体验。

我们再来看下这个例子:左边是普通缩放,右边则是3D魔法。

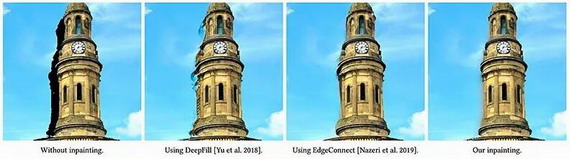

我们都知道,透视原理决定了前景比背景的移动和缩放更剧烈。所以当前景移动时,背景除了移动也要跟着修复。通过对比我们会发现:Ken Burns Effect 的背景修复十分自然,手法明显比其它“前辈”更高级:

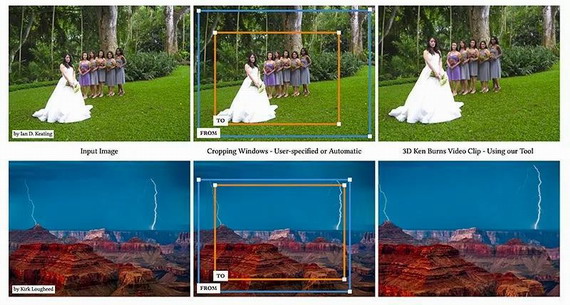

用户可以定义如何生成要缩放和平移的矩形,还可更改转换的持续时间和插值器,并暂停/恢复它们。

即使处理的图片背景的色彩和结构复杂也不怕,比如像这样往前靠近沙发,沙发会挡住后面窗户外的草地:

如果你觉得,刚才的视角变化只是由远及近,不够复杂。那就看一眼这条走廊吧,你仿佛正置身其中,就像在从上仰的视角变得平视前方。

再来看看这个:仿佛你打算走上台阶,所以正在朝着它的方向,慢慢转身。

除了风景之外,人像也不在话下。比如草地上的新娘与伴娘团,伴随着画面由远及近和由近及远的运动,简直活灵活现好嘛~~

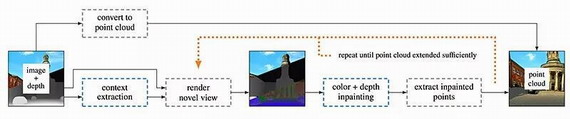

用单个图像合成逼真的相机移动的效果要解决两个基本问题。首先,要设置一个新的相机位置,合成新视图,并且需要准确地恢复原始视图的场景几何结构。

其次,根据预测的场景几何结构,要将新视图在连续的时间线上合成,这就涉及到去遮挡这样的图像修复手段。

研究人员们用了三个神经网络来构建处理框架。

用以训练的数据集是用计算机生成的。研究人员从 UE4 Marketplace2 收集了32种虚拟环境,用虚拟摄像机在32个环境中捕获了134041个场景,包括室内场景,城市场景,乡村场景和自然场景。

每个场景包含4个视图,每个视图都包含分辨率为512×512像素的颜色、深度和贴图。

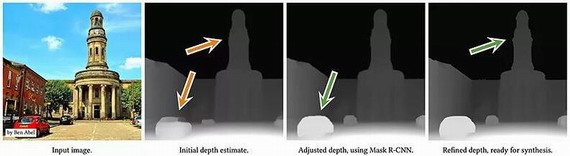

指定一张高分辨率图像,首先根据其低分辨率版本估计粗糙深度。这一步由 VGG-19来实现,根据它提取的语义信息指导深度估计网络的训练,并用具有ground truth 的计算机合成数据集进行监督。这样就能提取出原始图像的深度图。

第二个网络是 Mask R-CNN。为避免语义失真,平行于 VGG-19,用 Mask R-CNN 对输入的高分辨率图像进行分割,而后用分割的结果来对深度图进行调整,以确保图中的每个对象都映射到一个相干平面上。

最后利用深度细化网络,参考输入的高分辨率图像,对提取出的粗糙深度进行上采样,确保深度边界更加精确。

之所以要采用深度细化网络,是因为裁切对象的过程中,对象很可能在边界处被撕开。有了从输入图像获得的点云和深度图(点云指通过3D扫描得到的物品外观表面的点数据集合),就可以渲染连续的新视图了。

不过,这里又会出现一个新的问题——当虚拟摄像机向前移动的时候,对象本身会产生裂隙(下图中高塔右侧像被网格切开了)。

为了解决这个问题,研究人员采取了结合上下文感知修复的方法。这么做能产生更高质量的合成视图。上下文信息划定了相应像素在输入图像中位置的邻域,因此点云中的每个点都可利用上下文信息来进行扩展。

具体而言,第一步是进行颜色和深度图像修复,以从不完整的渲染中恢复出完整的新视图,其中每个像素都包含颜色,深度和上下文信息。然后利用图像修复深度将图像修复颜色映射到点云中新的色调点。

重复这一过程,直到点云充分扩展,填补空隙,可以实时地呈现完整且连续的画面。

129

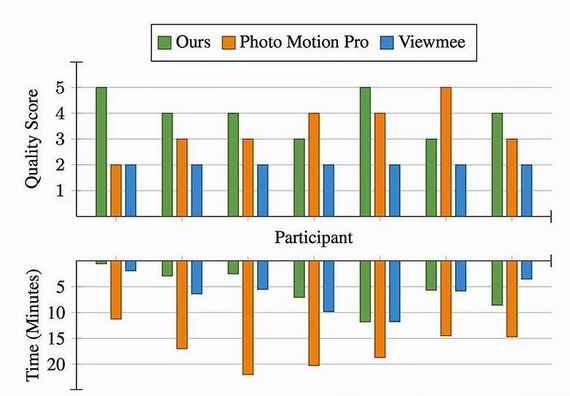

为了验证这个新方法效果如何,研究团队搞了个“非正式用户调研”。他们在油管上找了30个人创造的 3D Ken Burns 视频,将其分成“风景”,“肖像”,“室内”,“人造室外环境”四组,每组随机抽取三个视频作为样本。

8位志愿者参与到了这个测试之中。团队为每个志愿者分配了一张静态图,并提供了作品作为参考,要求他们使用新方法和 Adobe After Effects 模板、移动 App Viewmee 这两种 Ken Burns 制作工具创作类似的效果。

志愿者会依据自己的意见评价每种工具的可用性和质量。最后他们不论是从效果上,还是易用性上,Adobe 的这个新工具显然好得多。

这项研究的第一作者,是波特兰州立大学的博士生 Simon Niklaus,研究方向为计算机视觉与深度学习。他在 Adobe Research 实习时完成了这项工作,目前他正在Google实习。

他的博士生导师 Feng Liu 也是这一研究的作者之一。这项研究还有另外两名作者 Long Mai 和 Jimei Yang,都是 Adobe 的研究科学家。

目前,Simon Niklaus 已经计划公布代码以及数据集,但还没有得到批准。因为这项工作是“实习生”完成的, Adobe在开源方面都比较大度。当然,这也无法排除他们商业化的可能性。

手游排行榜

- 最新排行

- 最热排行

- 评分最高

-

破解游戏 大小:343.62 MB

-

角色扮演 大小:1.02GB

-

角色扮演 大小:21.32 MB

-

体育比赛 大小:141.9 MB

-

闯关冒险 大小:350.21 MB

-

破解游戏 大小:715.5M

-

经营策略 大小:1.57 GB

-

破解游戏 大小:719.5M